|

|

Этап центрирования входных переменныхДля этого, сначала входные обобщенные переменные

В дальнейшем волну в обозначениях переменных опусим подразумевая что переменные центрированы. Теперь в центрированных переменных Уравнения модели можем писать в виде

Можно показать что ниже описанная процедура формирования модели первого и последующих рядов позволяет находить модель в виде

Вы спросите?– а нужна ли еще зачем-то отрогонализация (кроме уменьшения еще на 1 размерности вектора параметров, который ищем через МНК) -из

Рис1 Рис 2 Рис 3 Рис 4 Напомним, что параметры расчитанные на ортогональных входных аргументах (независимых) наиболее точно расчитаны – для этого варианта расчета плоскость аргументов, куда опускается проекция, в пространстве расположена наиболее «устойчиво » относительно шума в данных – угол между векторами – таким образом ш ум данных на положение плоскости влияет в наименшей степени и таким образом посчитанная модель имеет наименьшую погрешность связанную с наличием шума.

Коэффициенты

Вывод формулы МНК для одномерного случая повторим применяя ранее ипользовавшийся прием: Нам необходимо приблизить

где точка – знак скалярного произведения векторов. Тоже самое можем записать в виде

Далее будем искать ортогонализироваые частные модели описание в виде здесь

При условии центрирования переменных по среднему значению в частных частных моделях (1) как уже говорили свободный член равен нулю, а коэффициент при третьем члене

где вектор Ортогональна добавка

где коэффициент

Смысл проведенного преобразования в том, что исходный вектор По сути эта процедура проекии является процедурой расчета методом наименш квадратов коефициету Сходимость алгоритма по моделям Сходимость последовательности.

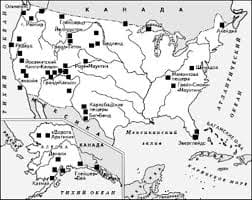

Что делать, если нет взаимности? А теперь спустимся с небес на землю. Приземлились? Продолжаем разговор...  Система охраняемых территорий в США Изучение особо охраняемых природных территорий(ООПТ) США представляет особый интерес по многим причинам...  Живите по правилу: МАЛО ЛИ ЧТО НА СВЕТЕ СУЩЕСТВУЕТ? Я неслучайно подчеркиваю, что место в голове ограничено, а информации вокруг много, и что ваше право...  Что будет с Землей, если ось ее сместится на 6666 км? Что будет с Землей? - задался я вопросом... Не нашли то, что искали? Воспользуйтесь поиском гугл на сайте:

|