|

|

Однослойные и многослойные нейронные сетиПростейшая сеть состоит из группы нейронов, образующих слой, как показано в правой части рис. 10.6. Вершины – круги слева служат только для распределения входных сигналов. Нейроны на схеме обозначены квадратами. Каждый элемент из множества входов Х отдельным весом соединен с каждым нейроном. А каждый нейрон выдает взвешенную сумму входов. В целях общности показаны все соединения. В конкретной сети некоторые соединения могут отсутствовать. Могут иметь место также соединения между выходами и входами нейронов в слое. Веса будем считать элементами матрицы W размера m х n, где m – число входов, n – число нейронов. Например, w 23 – это вес связи, соединяющей второй вход с третьим нейроном. Таким образом, вычисление выходного вектора N,компонентами которого являются выходы OUT нейронов, сводится к матричному умножению

Рис. 10.6 Однослойная нейронная сеть Многослойные сети образуются каскадами слоев. Выход одного слоя является входом для последующего слоя. Подобная сеть показана на рис. 10.7.

Рис. 10.7 Двухслойная нейронная сеть До сих пор рассматривались сети прямого распространения, у которых нет обратных связей, т.е. соединений, идущих от выходов некоторого слоя к входам этого же слоя или предшествующих слоев. Сети более общего вида, имеющие такие соединения, называют сетями с обратными связями. У сетей без обратной связи нет памяти. Их выход полностью определяется текущими входами и значениями весов. В некоторых конфигурациях сетей с обратными связями предыдущие значения выходов возвращаются на входы. Выход, следовательно, определяется как текущим входом, так и предыдущими выходами, поэтому сети с обратными связями могут обладать свойствами, сходными с кратковременной человеческой памятью, сетевые выходы частично зависят от предыдущих входов. Персептрон Розенблатта Одной из первых искусственных сетей, способных к перцепции (восприятию) и формированию реакции на воспринятый стимул, явился персептрон Розенблатта (1957). Простейший классический персептрон содержит нейроподобные элементы трех типов (см. рис. 10.8), назначение которых в целом соответствует нейронам рефлекторной нейронной сети. S -элементы формируют слой сенсорных клеток, принимающих двоичные сигналы от внешнего мира. Далее сигналы поступают в слой ассоциативных или A -элементов (для упрощения изображения часть связей от входных S -клеток к A -клеткам не показана). Только ассоциативные элементы, представляющие собой формальные нейроны, выполняют нелинейную обработку информации и имеют изменяемые веса связей. R -элементы с фиксированными весами формируют сигнал реакции персептрона на входной стимул.

Рис. 10.8 Персептрон Розенблатта. Розенблатт называл такую нейронную сеть трехслойной, однако по современной терминологии представленная сеть называется однослойной, так как имеет только один слой нейропроцессорных элементов. Однослойный персептрон характеризуется матрицей синаптических связей W от S - к A -элементам. Элемент матрицы В работах Розенблатта был сделано заключение о том, что нейронная сеть рассмотренной архитектуры будет способна к воспроизведению любой логической функции, однако, как было показано позднее М.Минским и С.Пейпертом (1969), этот вывод оказался неточным. Были выявлены принципиальные неустранимые ограничения однослойных персептронов, и в последствии стал в основном рассматриваться многослойный вариант персептрона, в котором имеются несколько слоев процессорных элементов. С сегодняшних позиций однослойный персептрон представляет скорее исторический интерес, однако на его примере могут быть изучены основные по- нятия и простые алгоритмы обучения нейронных сетей. Обучение персептрона Обучение сети состоит в подстройке весовых коэффициентов каждого нейрона. Пусть имеется набор пар векторов Предложенный Ф.Розенблаттом метод обучения состоит в итерационной подстройке матрицы весов, последовательно уменьшающей ошибку в выходных векторах. Алгоритм включает следующие шаги:

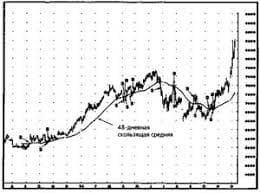

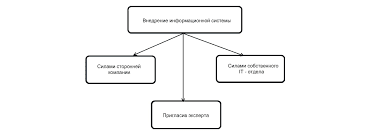

Используемая на шаге 3 формула учитывает следующие обстоятельства: а) модифицируются только компоненты матрицы весов, отвечающие ненуле- вым значениям входов; б) знак приращения веса соответствует знаку ошибки, т.е. положительная ошибка ( Данный метод обучения был назван Ф.Розенблаттом “методом коррекции с обратной передачей сигнала ошибки”. Позднее более широко стало известно название “ Доказанная Розенблаттом теорема о сходимости обучения по   Что вызывает тренды на фондовых и товарных рынках Объяснение теории грузового поезда Первые 17 лет моих рыночных исследований сводились к попыткам вычислить, когда этот...  ЧТО ПРОИСХОДИТ, КОГДА МЫ ССОРИМСЯ Не понимая различий, существующих между мужчинами и женщинами, очень легко довести дело до ссоры...  Что делать, если нет взаимности? А теперь спустимся с небес на землю. Приземлились? Продолжаем разговор...  Что делает отдел по эксплуатации и сопровождению ИС? Отвечает за сохранность данных (расписания копирования, копирование и пр.)... Не нашли то, что искали? Воспользуйтесь поиском гугл на сайте:

|