|

|

Подходы к оценке количества информации

Используется два подхода: вероятностный или алфавитный. Вероятностный подход к измерению информации Любая информация может рассматриваться как уменьшение неопределенности наших знаний об окружающем мире (в теории информации принято говорить именно об уменьшении неопределенности, а не об увеличении объема знаний). Математически это высказывание эквивалентно простой формуле I = H1 – H2 где I — это количество информации, а H1 и H2 — начальная и конечная неопределенность соответственно. Величину H, которая описывает степень неопределенности, в литературе принято называть энтропией. Важным частным случаем является ситуация, когда некоторое событие с несколькими возможными исходами уже произошло, а, значит, неопределенность его результата исчезла. Тогда H2 = 0 и формула для информации упрощается: I = H Вычисление энтропии при вероятностном подходе базируется на рассмотрении данных о результате некоторого случайного события, т.е. события, которое может иметь несколько исходов. Случайность события заключается в том, что реализация того или иного исхода имеет некоторую степень неопределенности. Пусть, например, абсолютно незнакомый нам ученик сдает экзамен, результатом которого может служить получение оценок 2, 3, 4 или 5. Поскольку мы ничего не знаем о данном ученике, то степень неопределенности всех перечисленных результатов сдачи экзамена совершенно одинакова. Напротив, если нам известно, как он учится, то уверенность в некоторых исходах будет больше, чем в других: так, отличник скорее всего сдаст экзамен на пятерку, а получение двойки для него — это нечто почти невероятное. Наиболее просто определить количество информации в случае, когда все исходы события могут реализоваться с равной долей вероятности. В этом случае для вычисления информации используется формула Хартли. В более сложной ситуации, когда исходы события ожидаются с разной степенью уверенности, требуются более сложные вычисления по формуле Шеннона. Очевидно, что формула Хартли является некоторым частным случаем более общей формулы Шеннона. Формула Хартли была предложена в 1928 году американским инженером Р.Хартли. Она связывает количество равновероятных состояний N с количеством информации I в сообщении о том, что любое из этих состояний реализовалось. Наиболее простая форма для данной формулы записывается следующим образом: 2I = N Причем обычно значение N известно, а I приходится подбирать, что не совсем удобно. Поэтому те, кто знает математику получше, предпочитают преобразовать данную формулу так, чтобы сразу выразить искомую величину I в явном виде: I = log2 N Важный частный случай получается из приведенной формулы при N = 2, когда результатом вычисления является единичное значение. Единица информации носит название бит (от англ. BInary digiT — двоичная цифра); таким образом, 1 бит — это информация о результате опыта с двумя равновероятными исходами. Чем больше возможных исходов, тем больше информации в сообщении о реализации одного из них. Пример 1. Из колоды выбрали 16 карт (все “картинки” и тузы) и положили на стол рисунком вниз. Верхнюю карту перевернули (см. рисунок). Сколько информации будет заключено в сообщении о том, какая именно карта оказалась сверху? Все карты одинаковы, поэтому любая из них могла быть перевернута с одинаковой вероятностью. В таких условиях применима формула Хартли. Событие, заключающееся в открытии верхней карты, для нашего случая могло иметь 16 возможных исходов. Следовательно, информация о реализации одного из них равняется I = log216 = 4 бита Пример 2. Решите предыдущую задачу для случая, когда сообщение об исходе случайного события было следующим: “верхняя перевернутая карта оказалась черной дамой”. Отличие данной задачи от предыдущей заключается в том, что в результате сообщения об исходе случайного события не наступает полной определенности: выбранная карта может иметь одну из двух черных мастей. В этом случае, прежде чем воспользоваться формулой Хартли, необходимо вспомнить, что информация есть уменьшение неопределенности знаний: I = H1 – H2 До переворота карты неопределенность (энтропия) составляла H1 = log2 N1 после него — H2 = log2 N2 (причем для нашей задачи N1 = 16, а N2 = 2). В итоге информация вычисляется следующим образом: I = H1 – H2 = log2 N1 – log2 N2 = log2 N1/N2 = log2 16/2 = 3 бита Заметим, что в случае, когда нам называют карту точно (см. предыдущий пример), неопределенность результата исчезает, N2 = 1, и мы получаем “традиционную” формулу Хартли. И еще одно полезное наблюдение. Полная информация о результате рассматриваемого опыта составляет 4 бита (см. пример 1). В данном же случае мы получили 3 бита информации, а оставшийся четвертый описывает сохранившуюся неопределенность выбора между двумя дамами черной масти. Определим теперь, являются ли равновероятными сообщения "первой выйдет из дверей здания женщина" и "первым выйдет из дверей здания мужчина". Однозначно ответить на этот вопрос нельзя. Все зависит от того, о каком именно здании идет речь. Если это, например, станция метро, то вероятность выйти из дверей первым одинакова для мужчины и женщины, а если это военная казарма, то для мужчины эта вероятность значительно выше, чем для женщины. Для задач такого рода американский учёный Клод Шеннон предложил в 1948 г. другую формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе.

где pi — вероятность того, что именно i-е сообщение выделено в наборе из N сообщений Легко заметить, что если вероятности pi равны, то каждая из них равна 1/N, и формула Шеннона превращается в формулу Хартли.

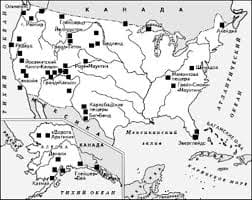

Система охраняемых территорий в США Изучение особо охраняемых природных территорий(ООПТ) США представляет особый интерес по многим причинам...  Что делать, если нет взаимности? А теперь спустимся с небес на землю. Приземлились? Продолжаем разговор...  ЧТО И КАК ПИСАЛИ О МОДЕ В ЖУРНАЛАХ НАЧАЛА XX ВЕКА Первый номер журнала «Аполлон» за 1909 г. начинался, по сути, с программного заявления редакции журнала...  Конфликты в семейной жизни. Как это изменить? Редкий брак и взаимоотношения существуют без конфликтов и напряженности. Через это проходят все... Не нашли то, что искали? Воспользуйтесь поиском гугл на сайте:

|