|

|

Дифференциальная энтропия

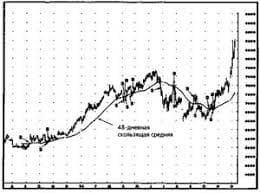

Источники информации, множество возможных состояний которых составляют континуум, называют непрерывными. Во многих случаях они преобразуются в дискретные посредством использования устройств дискретизации и квантования. Вместе с тем существует немало и таких систем, в которых информация передаётся и преобразуется непосредственно в форме непрерывных сигналов. Примерами могут служить системы телеизмерений с частотным разделением сигналов. Основные информационные характеристики источников непрерывных сообщений следующие: энтропия, условная энтропия, эпсилон – энтропия, эпсилон – производительность, избыточность, объём информации. Формулу для энтропии источника непрерывных сообщений получают путем предельного перехода из формулы (2.14) для энтропии дискретного источника. С этой целью разобьём диапазон изменения непрерывной случайной величины Х, характеризующейся плотностью распределения вероятностей W (X), на конечное число m малых интервалов шириной D x (рис. 4.1). При реализации любого значения х, принадлежащего интервалу [ xi, xi +D x ], будем считать, что реализовалось значение xi дискретной случайной величины Х. Поскольку D x мало, то вероятность

Тогда энтропия дискретной случайной величины

так как По мере уменьшения В результате предельного перехода при

Первый член выражения (4.2) зависит только от закона распределения непрерывной случайной величины Х и имеет такую же структуру, как энтропия дискретного источника. Второй член  стремится к бесконечности, это полностью соответствует интуитивному представлению о том, что неопределенность выбора из бесконечно большого числа возможных состояний (значений) бесконечно велика. стремится к бесконечности, это полностью соответствует интуитивному представлению о том, что неопределенность выбора из бесконечно большого числа возможных состояний (значений) бесконечно велика.

Рис. 3.1. Зависимость плотности распределения вероятностей случайной величины

Чтобы избавить теорию от бесконечности, имеется единственная возможность – ввести относительную меру неопределенности исследуемой непрерывной случайной величины Х по отношению к заданной Х 0. В качестве заданной величины Х 0 возьмем непрерывную случайную величину, равномерно распределенную на интервале с шириной

Положив для простоты записи e = 1, составим разность

которая показывает, насколько неопределенность непрерывной случайной величины Х с законом распределения W (X) больше

называют относительной дифференциальной энтропией или просто дифференциальной энтропией непрерывного источника информации (непрерывного распределения случайной величины Х). В отличие от энтропии источников дискретных сообщений Аналогично, используя операции квантования и предельного перехода, найдем выражение для условной энтропии непрерывного источника сообщений.

Обозначим первый член через

Эта величина конечна и называется относительной дифференциальной условной энтропией, или просто дифференциальной условной энтропией непрерывного источника. Она характеризует неопределенность выбора непрерывной случайной величины Х при условии, что известны результаты реализации значений другой статистически связанной с ней непрерывной случайной величины Y, и по сравнению со средней неопределенностью выбора случайной величины Х 0, изменяющейся в диапазоне, равном единице, и имеющей равномерное распределение вероятностей.

Конфликты в семейной жизни. Как это изменить? Редкий брак и взаимоотношения существуют без конфликтов и напряженности. Через это проходят все...  Живите по правилу: МАЛО ЛИ ЧТО НА СВЕТЕ СУЩЕСТВУЕТ? Я неслучайно подчеркиваю, что место в голове ограничено, а информации вокруг много, и что ваше право...  Что делать, если нет взаимности? А теперь спустимся с небес на землю. Приземлились? Продолжаем разговор...  Что вызывает тренды на фондовых и товарных рынках Объяснение теории грузового поезда Первые 17 лет моих рыночных исследований сводились к попыткам вычислить, когда этот... Не нашли то, что искали? Воспользуйтесь поиском гугл на сайте:

|