|

|

часть iii. многомерные методы и модели⇐ ПредыдущаяСтр 29 из 29 ПРИМЕР 18.2 ____________________________________________________________________ В уже упоминавшемся исследовании восприятия студентами учебных предметов1 каждый из 73 студентов оценивал различия между 14 элементами, в качестве которых выступали пройденные учебные курсы. Полученный массив данных (73 матрицы) обрабатывался при помощи МШ индивидуальных различий. Было получено 3-шкальное решение — достаточно устойчивое и воспроизводимое. Оно оказалось общим для большинства из опрошенных студентов. Для интерпретации шкал далее были проведены структурированные интервью (метод выявления конструктов), материалом для которых являлись учебные дисциплины, поляризованные по шкалам. При проведении интервью учитывалось индивидуальное своеобразие точек зрения опрашиваемого (по результатам шкалирования). Удалось выявить общие конструкты — критерии восприятия студентами учебных курсов. Ими оказались: 1 — «биодетерминизм — социодетерминизм» (в объяснении причин поведения); 2 — «исследование — коррекция» (на чем делается акцент в содержании дисциплины); 3 — «общие — прикладные» (по широте применения или назначения дисциплины). Интересно отметить, что те же конструкты были выявлены и у тех, чьи данные не соответствовали групповым и для которых были составлены индивидуальные поляризации предметов для интервью — в соответствии с результатами шкалирования индивидуальных матриц. ПРИМЕР 18.3 ____________________________________________________________________ Изучалась структурированность представлений студентов о разных психологических концепциях. Для этого двум студентам предлагалось сравнить попарно по степени различия концепции пяти ученых: В. Вундта, Э. Титченера, И. М. Сеченова, Э. Торндайка и М. Вертгеймера. В процедуре исследования каждому студенту было предложено оценивать различие концепций в каждой паре из всех возможных сочетаний (всего 5(5 — 1)/2 = 10 пар) по 5-балльной шкале (1 — очень похожи, 5 — совсем не похожи). Результаты оценки различий представлены в табл. 18.5. Та б л и ц а 18.5

Обработка на компьютере Для обработки воспользуемся данными примера 18.3. Исходные данные (1)а1а Ейког) представляют собой нижние треугольники матриц попарных различий между 5 объектами (табл. 18.4). Для реализации программы ШБ8САЬ необходимо, чтобы матрицы для разных субъектов находились друг под другом. В нашем примере вторая матрица расположена под первой. 1. Выбираем Апа1уге > 8са1е > Ми1йШте1Шопа1 8саПп§ (АЬ8САЬ)... Примечание. Если данные представляют собой оценки объектов по ряду признаков каждым из экспертов (испытуемых), а не матрицы различий, то вместо программы АЬ8САЬ лучше воспользоваться программой РЯОХ8САЬ. 2. В открывшемся окне диалога переносим из левого в правое верхнее окно (УапаЫев) переменные, необходимые для шкалирования (VI, V2, V3, V4, V5). Убеждаемся, что в поле Б181апсе8 (Расстояния) точкой отмечено Ба1а аге йЫапсез (Данные — расстояния), а нажав кнопку 8Ьаре... (Уточнить), убеждаемся, что матрица данных 8^иа^е 8утте1пс (Симметричная квадратная). Нажимаем СопИпие. 3. Нажимаем кнопку Мойе1... (Модель...) и задаем параметры модели шкалирования. Для данной модели главный параметр — 8саПп§ шойе1 (Модель шкалирования). Вместо заданной по умолчанию ЕисКйеап Й18(апсе (Евклидово расстояние) задаем 1пЙ1Ун1иа1 Й1Йегепсе8 ЕисНйеап сИ$1апсе (Евклидово расстояние индивидуальных различий). В отношении остальных установок руководствуемся теми же соображениями, что и при реализации модели неметрического шкалирования. Следующим параметром является количество шкал. Обычно следует получить результаты для нескольких шкал и выбрать наилучшее из них — по величинам стресса и по отчетливости интерпретации. В данном случае у нас всего 5 объектов, поэтому вряд ли потребуется более двух шкал. Задаем 01теп810п8 (Шкалы) > Мттшт: 2 (Минимум), Махтшт: 2 (Максимум). Параметры Ьеуе1 оГ теавигетеп! (Уровень измерения) можно не менять и оставить принятые по умолчанию Огйша1 (Порядковый): их изменение практически не меняет результаты. Разве что можно поставить флажок ШНе Ней оЬзегуайоп (Корректировать связанные наблюдения) — для устранения влияния связей (повторов) в рангах. Убеждаемся, что установлено СопйШопаШу: Ма1пх (Условие подгонки: вся матрица). После задания всех параметров модели нажимаем СопНпие. 4. В основном окне диалога нажимаем ОрНоп8 (Опции) для задания параметров обработки и вывода результатов. В появившемся окне диалога внизу в поле Б|8р1ау (Вывод) отмечаем флажком Сгоир р1о18 (Графики для всей группы) — для графического отображения объектов в координатах шкал. В поле Сгйепа (Критерий) указаны критерии для итераций по подгонке модели: 5-81ге$$ сопуегеепсе: 0,001 (Величина сходимости з-стресса), Мпшпит 8-81ге88 уа1ие: 0,005 (Минимальная величина з-стресса), Махшит ИегаНопз: 30 (Мак- После задания всех параметров обработки и вывода результатов нажимаем Сопипие. Нажимаем ОК и получаем результаты. 5. Основные результаты МШ индивидуальных различий. A) «История» итераций: ГЬегаЫоп 3-з(;гезз 1шргсл/етеп1; (Итерация) (5-стресс) (Улучшение) 0.00096 1.00074 ТЬегаЫопз зЬоррей Ьесаизе 8-зЬгезз 13 1езз ЬЬап.005000 (Итерации остановлены, поскольку 5-стресс меньше, чем 0,005.)

B) Величины стресса и К.50 для каждой матрицы отдельно:

Эти величины свидетельствуют об отличной общей подгонке результатов, в том числе — для каждой матрицы отдельно. Следовательно, можно приступать к интерпретации результатов. С) Координаты стимулов и субъективные веса для каждой матрицы:

О) График конфигурации стимулов в осях шкал:

Е) Конфигурация субъективных весов в осях шкал:

При МШ индивидуальных различий интерпретируются две группы результатов: а) общее для группы испытуемых координатное представление сравниваемых объектов (общие точки зрения); б) субъективные (индивидуальные) веса общих точек зрения для каждого субъекта. На отрицательном полюсе первой шкалы расположена концепция М. Вертгеймера, затем, по мере возрастания значений шкалы: Э. Торндайк, Э. Титченер, В. Вундт, И. Сеченов. Очевидно, что эта шкала отражает временные представления студентов о последовательности появления концепций: чем меньше значения по этой шкале, тем позже появилась концепция. Вторая шкала отражает, скорее, содержательные представления студентов о концепциях: на положительном ее полюсе располагаются концепции, выражающие объективный подход к анализу поведения (И. М. Сеченов, Э. Торндайк); на отрицательном полюсе — интроспективный подход к анализу сознания (В. Вундт, Э. Титченер). Индивидуальные веса шкал показывают различия испытуемых по тому, насколько каждый из них разделяет общие (групповые) точки зрения. Для студента 1 преимущественное значение имеет содержательная характеристика концепций (шкала 2) и в меньшей степени — последовательность их появления (шкала 1). Студент 2 учитывает в большей степени последовательность появления концепций и почти полностью игнорирует их содержательное своеобразие. МОДЕЛЬ СУБЪЕКТИВНЫХ ПРЕДПОЧТЕНИЙ Исходными данными для шкалирования предпочтений является матрица размерностью РхЫ, содержащая N строк — по одной для каждого субъекта, присваивающего номера Робъектам по степени предпочтения: от 1 — самому предпочитаемому до Р — наименее предпочтительному. В соответствии с моделью предпочтений каждый субъект характеризуется идеальным объектом, а степень предпочтения стимула определяется его отличием от идеала. Дистанционная модель предпочтений основана на предположении, что субъекты могут быть охарактеризованы координатами идеальных точек в едином пространстве. Это пространство задается шкалами, которые трактуются как критерии, по которым осуществляются предпочтения. Координата х5к — то значение признака к, которое считает идеальным субъект 5. Все значения АГпризнаков определяют набор характеристик идеального объекта. Соответственно, номер или ранг предпочтения определяется как степень отличия данного объекта от идеала — 8Й. Чем больше ранг предпочтения, тем меньше нравится объект, то есть тем дальше он от идеала.

Формально неметрическая дистанционная модель предпочтений предполагает выполнение следующих соотношений: . < Зд => 4 < <1]5 для всех (/,/) субъекта ^ (18.3) Первое соотношение обозначает, что для каждого субъекта есть своя монотонная функция /5, что избавляет от необходимости приписывать субъектам единую шкалу для субъективных предпочтений. Второе соотношение ограничивает координаты объектов х1к и идеальных точек х5кв искомом пространстве так, чтобы сохранить порядковую информацию о соотношении объектов для каждого субъекта. Такой анализ называется условным по строке (строки соответствуют субъектам), в отличие от безусловного ограничения (по строкам и столбцам), применяемого в неметрическом шкалировании данных об индивидуальных различиях. Программа неметрического шкалирования АЬ8САЬ, включенная в состав 8Р55, может выполнять и неметрический анализ предпочтений, если задать прямоугольную матрицу (гес1ап§и1аг) с количеством строк (го\у), соответствующим количеству субъектов, но не менее 4. Дополнительно необходимо задать «условность по строке» (Сопс1Шопа1: Яо\у) в соответствии с требованием выражения 18.3. Критерии качества координатного представления объектов и правила выбора числа координат при анализе предпочтений те же, что в модели неметрического МШ данных о различиях. Однако матрица координат объектов включает в себя и координаты идеальных точек для каждого субъекта. Иными словами, конечный результат анализа предпочтений — это групповое пространство признаков (шкал), в котором наряду с объектами предпочтения размещены идеальные точки субъектов. Интерпретация этих результатов аналогична интерпретации результатов анализа различий. ПРИМЕР 18.4 _____________________________________________________________________ В упоминавшемся исследовании отношений студентов к учебным предметам (Лященко С., Наследов А., 2001) изучались и их предпочтения. В одной из серий исследования студентам предлагалось упорядочить 14 предметов по степени предпочтения стиля их преподавания. Исходные данные для 73 студентов обрабатывались при помощи многомерного шкалирования предпочтений. Результаты 3-шкального решения использовались для составления структурированных интервью. Таким образом были выделены основные критерии предпочтений учебных курсов с точки зрения стиля их преподавания. Ими оказались: 1 — «академичный — эмоциональный» стиль изложения материала; 2 — «диалогичный — монологичный» характер контакта с аудиторией; 3 — «доступная — сложная» манера изложения материала. ПРИМЕР 18.5 _____________________________________________________________________ Исследовались критерии предпочтения студентами различных психологических концепций. Каждому из четырех студентов было предложено ранжировать по степени предпочтения 6 концепций: 3. Фрейда, М. Вертгеймера, А. Адлера, Р. Кеттел- ла, Г. Айзенка и К. Левина (табл. 18.6), присваивая 1 наиболее и 6 наименее предпочитаемой концепции. Таблица 18.6

Обработка на компьютере Для обработки воспользуемся данными примера 18.5. Исходные данные (Ба(а ЕсШог) содержатся в таблице, строки которой соответствуют субъектам, а столбцы — объектам предпочтений (в соответствии с таблицей 18.6). 1. Выбираем Апа1уге > 8са1е > Ми1и(Ктеп§юпа1 8саНп§ (АЬ8САЬ)... 2. В открывшемся окне диалога переносим из левого в правое верхнее окно (УапаЫев) переменные, необходимые для шкалирования (VI, у2, уЗ, у4, у5, у6). Убеждаемся, что в поле 01$(апсе$ (Расстояния) точкой отмечено Оа(ааге сИ$(апсе$ (Данные — расстояния). 3. Необходимо задать тип матрицы различий. Нажав кнопку 8Ьаре... (Уточнить) вместо принятой по умолчанию 8^иа^е $утте(пс (Симметричная квадратная), отмечаем Кес(ап§и1аг (Прямоугольная). Указываем число строк, которое должно соответствовать численности экспертов (испытуемых): 1ЧшпЬег оГготе: 4 (Количество строк). Нажимаем Сопйпие. 4. Нажимаем кнопку Мойе1... (Модель...) и задаем параметры модели шкалирования. Для данной модели главный параметр СопйШопаШу (Условие подгонки). Вместо заданного по умолчанию Ма(пх (Вся матрица) задаем Ко» (По строке). Убеждаемся, что в поле 8саНп§ тойе1 (Модель шкалирования) отмечено ЕисНЛеап (1Ыапсе (Евклидово расстояние). Если в строках часто встречаются одинаковые ранги, то отмечаем флажком ШНе йей оЬзегуаиоп (Корректировать связанные наблюдения) — для устранения влияния связей (повторов) в рангах. Следующим параметром является количество шкал. Обычно следует получить результаты для нескольких шкал и выбрать наилучшее из них — по величинам стресса и по отчетливости интерпретации. В данном случае у нас всего 6 объектов, поэтому вряд ли потребуется более двух шкал. Задаем 0>теп$юп$ (Шкалы) МЫтит: 2, Махшит: 2. После задания всех параметров модели нажимаем СопШше. 5. В основном окне диалога нажимаем ОрИопв (Опции) для задания параметров обработки и вывода результатов. В появившемся окне диалога внизу в поле Б1$р1ау (Выводить) отмечаем флажком Сгоир р1о1$> (Графики для всей группы) — для графического отображения объектов в координатах шкал. В поле СгКепа (Критерии) указаны критерии для итераций по подгонке модели: 8-$(ге8$соп\ег§епсе: 0,001 (Величинасходимости 5-стресса), МЫтит$-$1ге$$ уа1ие: 0, 005 (Минимальная величина з-стресса), МахнпитКегаиопз: 3 0 (Максимальное количество итераций). Эти величины можно не менять. В отношении этих величин руководствуемся теми же соображениями, что и при реализации модели неметрического шкалирования. После задания всех параметров обработки и вывода результатов нажимаем Соп1тие. Нажимаем ОК и получаем результаты. 6. Основные результаты МШ предпочтений. А) «История» итераций, величины стресса и К§0: 1ЬегаЫоп ЫзЬогу Еог Ыте 2 Й1тепз10па1 зо1и(:1оп (История итераций для 2-шкального решения.)

В) Величины стресса и К§0 для каждой строки отдельно:

Величина стресса и К$0 для всех матриц: Рог та1;г1х (Для всей матрицы) ЗЫезз =.029 КЗО =.999. История итераций показывает, что минимальная величина достигнута на втором шаге, что, на самом деле, встречается очень редко. Обычно при большем количестве объектов проблемой является слишком большая величина стресса. Окончательная величина стресса (по формуле 2 Краскала) и величина К$0 свидетельствуют о высоком соответствии исходным данным всего решения. Величины для каждой строки отдельно показывают высокое соответствие исходным данным и результатов для каждого эксперта. С) Координаты объектов (Со1ишп) и идеальных точек (Яо\у) в осях шкал:

Э) График конфигурации объектов и идеальных точек в осях шкал:

Г -2-1 0 1 2 01тепзюп 1 |

Результаты анализа позволяют достаточно определенно интерпретировать основания предпочтений по координатам объектов. Шкала 1 интерпретируется как дихотомия побуждений (3. Фрейд, А. Адлер) и познания (М. Вертгеймер). Шкала 2 противопоставляет концепции, рассматривающие личностные свойства (Р. Кеттелл, Г. Айзенк) и ситуативные условия (К. Левин) в качестве основных причин поведения.

| 1,51,0 см 0,5 с о 'ё 0,0 ш Е О -0,5 -1,0 -1,5 |

Координаты идеальных точек позволяют идентифицировать индивидуальные субъективные предпочтения. Так, эксперт 1 предпочитает когнитивные концепции, а эксперт 2 — психоанализ.

Глава 19

КЛАСТЕРНЫЙ АНАЛИЗ

НАЗНАЧЕНИЕ

Кластерный анализ решает задачу построения классификации, то есть разделения исходного множества объектов на группы (классы, кластеры). При этом предполагается, что у исследователя нет исходных допущений ни о составе классов, ни об их отличии друг от друга. Приступая к кластерному анализу, исследователь располагает лишь информацией о характеристиках (признаках) для объектов, позволяющей судить о сходстве (различии) объектов, либо только данными об их попарном сходстве (различии). В литературе часто встречаются синонимы кластерного анализа: автоматическая классификация, таксономический анализ, анализ образов (без обучения).

Несмотря на то, что кластерный анализ известен относительно давно (впервые изложен Тгуоп в 1939 году), распространение эта группа методов получила существенно позже, чем другие многомерные методы, такие, как факторный анализ. Лишь после публикации книги «Начала численной таксономии» биологами Р. Сокэл и П. Снит в 1963 году начинают появляться первые исследования с использованием этого метода. Тем не менее, до сих пор в психологии известны лишь единичные случаи удачного применения кластерного анализа, несмотря на его исключительную простоту. Вызывает удивление настойчивость, с которой психологи используют для решения простой задачи классификации (объектов, признаков) такой сложный метод, как факторный анализ. Вместе с тем, как будет показано в этой главе, кластерный анализ не только гораздо проще и нагляднее решает эту задачу, но и имеет несомненное преимущество: результат его применения не связан с потерей даже части исходной информации о различиях объектов или корреляции признаков.

Варианты кластерного анализа — это множество простых вычислительных процедур, используемых для классификации объектов. Классификация объектов — это группирование их в классы так, чтобы объекты в каждом классе были более похожи друг на друга, чем на объекты из других классов. Более точно, кластерный анализ — это процедура упорядочивания объектов в сравнительно однородные классы на основе попарного сравнения этих объектов по предварительно определенным и измеренным критериям.

Существует множество вариантов кластерного анализа, но наиболее широко используются методы, объединенные общим названием иерархический кластерный анализ (ШегагсМсаI С1из1ег Апа1ут). В дальнейшем под кластерным анализом мы будем подразумевать именно эту группу методов. Рассмотрим основной принцип иерархического кластерного анализа на примере.

ПРИМЕР 19.1__________________________________________________________

Предположим, 10 студентам предложили оценить проведенное с ними занятие по двум критериям: увлекательность (РгеГ) и полезность (11$е). Для оценки использовалась 10-балльная шкала. Полученные данные (2 переменные для 10 студентов) графически представлены в виде графика двумерного рассеивания (рис. 19.1). Конечно, классификация объектов по результатам измерения всего двух переменных не требует применения кластерного анализа: группировки и так можно выделить путем визуального анализа. Так, в данном случае наблюдаются четыре группировки: 9, 2, 3 — занятие полезное, но не увлекательное; 1, 10, 8 — занятие увлекательное, но бесполезное; 5,1 — занятие и полезное и увлекательное; 4, 6 — занятие умеренно увлекательное и умеренно полезное. Даже для трех переменных можно обойтись и без кластерного анализа, так как компьютерные программы позволяют строить трехмерные графики. Но для 4 и более переменных визуальный анализданных практически невозможен. Тем не менее, общий принцип классификации объектов при помощи кластерного анализа не зависит от количества измеренных признаков, так как непосредственной информацией для этого метода являются различия между классифицируемыми объектами.

|

| 9,00 8,00 7,00 6,00 2> О. 5,00 4,00 3,00 2,00 |

| Рис. 19.1. График двумерного рассеивания переменных «увлекательность» (Рге!) и «польза» (У$е) для 10 студентов |

| 2,00 3,00 |

| 5,00 6,00 иве |

Кластерный анализ объектов, для которых заданы значения количественных признаков начинается с расчета различий для всех пар объектов. Пользователь может выбрать по своему усмотрению меру различия, обзор которых приведен в соответствующем разделе главы 18. В качестве меры различия выбирается расстояние между объектами в Р-мерном пространстве признаков, чаще всего — евклидово расстояние или его квадрат. В данном случае Р= 2 и евклидово расстояние между объектами <иу определяется формулой:

где х — это значения одного, а у — другого признака.

На первом шаге кластерного анализа путем перебора всех пар объектов определяется пара (или пары) наиболее близких объектов, которые объединяются в первичные кластеры. Далее на каждом шаге к каждому первичному кластеру присоединяется объект (кластер), который к нему ближе. Этот процесс повторяется до тех пор, пока все объекты не будут объединены в один кластер. Критерий объединения объектов (кластеров) может быть разным и определяется методом кластерного анализа. Основным результатом применения иерархического кластерного анализа является дендрограмлш — графическое изображение последовательности объединения объектов в кластеры. Для данного примера дендрограмма приведена на рис. 19.2.

Рис. 19.2. Дендрограмма для 10 студентов (метод средней связи)

Рис. 19.2. Дендрограмма для 10 студентов (метод средней связи)

|

На дендрограмме номера объектов следуют по вертикали. По горизонтали отмечены расстояния (в условных единицах), на которых происходит объединение объектов в кластеры. На первых шагах происходит образование кластеров: (3,9,2) и (5,7). Далее образуется кластер (8, 10, 1) — расстояния между этими объектами больше, чем между теми, которые были объединены на предыдущих шагах. Следующий кластер — (4, 6). Далее в один кластер объединяются кластеры (5, 7) и (4, 6), и т. д. Процесс заканчивается объединением всех объектов в один кластер. Количество кластеров определяет по дендрограмме сам исследователь. Так, судя по дендрограмме, в данном случае можно выделить три или четыре кластера.

Как видно из примера, кластерный анализ — это комбинаторная процедура, имеющая простой и наглядный результат. Широта возможного применения кластерного анализа очевидна настолько же, насколько очевиден и его смысл. Классифицирование или разделение исходного множества объектов на различающиеся группы — всегда первый шаг в любой умственной деятельности, предваряющий поиск причин обнаруженных различий.

Можно указать ряд задач, при решении которых кластерный анализ является более эффективным, чем другие многомерные методы:

□ разбиение совокупности испытуемых на группы по измеренным признакам с целью дальнейшей проверки причин межгрупповых различий по внешним критериям, например, проверка гипотез о том, проявляются ли типологические различия между испытуемыми по измеренным признакам;

□ применение кластерного анализа как значительно более простого и наглядного аналога факторного анализа, когда ставится только задача группировки признаков на основе их корреляции;

П классификация объектов на основе непосредственных оценок различий между ними (например, исследование социальной структуры коллектива по данным социометрии — по выявленным межличностным предпочтениям).

Несмотря на различие целей проведения кластерного анализа, можно выделить общую его последовательность как ряд относительно самостоятельных шагов, играющих существенную роль в прийтадном исследовании:

1. Отбор объектов для кластеризации. Объектами могут быть, в зависимости от цели исследования: а) испытуемые; б) объекты, которые оцениваются испытуемыми; в) признаки, измеренные на выборке испытуемых.

2. Определение множества переменных, по которым будут различаться объекты кластеризации. Для испытуемых — это набор измеренных признаков, для оцениваемых объектов — субъекты оценки, для признаков — испытуемые. Если в качестве исходных данных предполагается использовать результаты попарного сравнения объектов, необходимо четко определить критерии этого сравнения испытуемыми (экспертами).

3. Определение меры различия между объектами кластеризации. Это первая проблема, которая является специфичной для методов анализа различий: многомерного шкалирования и кластерного анализа. Применяемые меры различия и требования к ним подробно изложены в главе 18 (раздел «Меры различия»),

4. Выбор и применение метода классификации для создания групп сходных объектов. Это вторая и центральная проблема кластерного анализа. Ее весомость связана с тем, что разные методы кластеризации порождают разные группировки для одних и тех же данных. Хотя анализ и заключается в обнаружении структуры, наделе в процессе кластеризации структура привносится в данные, и эта привнесенная структура может не совпадать с реальной.

5. Проверка достоверности разбиения на классы.

Последний этап не всегда необходим, например, при выявлении социальной структуры группы. Тем не менее следует помнить, что кластерный анализ

всегда разобьет совокупность объектов на классы, независимо от того, существуют ли они на самом деле. Поэтому бесполезно доказывать существенность разбиения на классы, например, на основании достоверности различий между классами по признакам, включенным в анализ. Обычно проверяют устойчивость группировки — на повторной идентичной выборке объектов. Значимость разбиения проверяют по внешним критериям — признакам, не вошедшим в анализ.

МЕТОДЫ КЛАСТЕРНОГО АНАЛИЗА

Непосредственными данными для применения любого метода кластеризации является матрица различий между всеми парами объектов. Определение или задание меры различия является первым и необходимым шагом кластерного анализа. Поэтому прежде, чем продолжить чтение, убедитесь, что вы уже знакомы с основными мерами различий, с требованиями к ним и со способами их получения (глава 18, раздел «Меры различия»).

Из всего множества методов кластеризации наиболее распространены так называемые иерархические агломеративные методы. Название указывает на то, что классификация осуществляется путем последовательного объединения (агломерации) объектов в группы, оказывающиеся в результате иерархически организованными. Эти методы — очень простые комбинаторные процедуры, отличающиеся критерием объединения объектов в кластеры.

|

Критерий объединения многократно применяется ко всей матрице попарных расстояний между объектами. На первых шагах объединяются наиболее близкие объекты, находящиеся на одном уровне сходства. Затем поочередно присоединяются остальные объекты, пока все они не объединятся в один большой кластер. Результат работы метода представляется графически в виде дендрограммы — ветвистого древовидного графика.

Существуют различные методы иерархического кластерного анализа, в частности, в программе 8Р88 предлагается 7 методов. Каждый метод дает свои результаты кластеризации, но три из них являются наиболее типичными. Поэтому рассмотрим результаты применения этих методов к одним и тем же данным из примера 19.1.

..пока все они не объединятся в один большой кластер

БепсЗгодгат изл.пд Зл.пд1е Ыпкаде

Кевса1е<3 ВхзЬапсе С1изСег СотЫпе

С А 3 Е 0 5 10 15 20 25

ЬаЬе1 Ыит Н-------------- 1------------ I--------------- 1------------- 1------------- 1-

3 —

9---------------------------------------------------------------------------------

2 —I

' з------------------------------------!

8 -------------------- -------------------------------------------------------------------------------------

10--------------------------

1 -------------- ----------------------------------------------------

4 ------------------------------------

6 ----------------------------------------------------

Рис. 19.3. Дендрограмма для 10 студентов (метод одиночной связи)

Метод одиночной связи (5т§1е Ыпка§е) — наиболее понятный метод, который часто называют методом «ближайшего соседа» {Ыеагев! ~Ые'1фЪог). Алгоритм начинается с поиска двух наиболее близких объектов, пара которых образует первичный кластер. Каждый последующий объект присоединяется к тому кластеру, к одному из объектов которого он ближе.

На рис. 19.3 приведен результат применения метода. Сопоставляя эту ден- дрограмму с рис. 19.1, можно заметить, что объект 4 присоединяется к кластеру (8, 10, 1) и на том же расстоянии — к объекту 6 в связи с тем, что расстояние от объекта 4 до объекта 6 такое же, что и до объекта 1. Из рисунка видно, что метод имеет тенденцию к образованию длинных кластеров «цепочного» вида. Таким образом, метод имеет тенденцию образовывать небольшое число крупных кластеров. К особенностям метода можно отнести и то, что результаты его применения часто не дают возможности определить, как много кластеров находится в данных.

Метод полной связи (Сошр1е1е 1лпка§е) часто называют методом «дальнего соседа» (Риг(Нез(Ые1фЪог). Правило объединения этого метода подразумевает, что новый объект присоединяется к тому кластеру, самый далекий элемент которого находится ближе к новому объекту, чем самые далекие элементы других кластеров. Это правило является противоположным предыдущему и более жестким. Поэтому здесь наблюдается тенденция к выделению большего числа компактных кластеров, состоящих из наиболее похожих элементов.

Сравним результат применения метода полной связи (рис. 19.4), метода одиночной связи (рис. 19.3) и фактическую конфигурацию объектов (рис. 19.2). Различия в работе методов проявляются прежде всего в отношении объектов 4 и 6. Метод полной связи объединяет их в отдельный кластер и соединяет с кластером (5, 7) раньше, чем с кластером (8, 10, 1) — в отличие от метода одиночной связи. Объект 4 присоединяется сначала к объекту 6, пото-

Бепйгодгат изхпд Сотр1еСе Ыпкаде

| 25 ---- Н |

Кезса1е<3 01в1:апсе С1ивСег СошЫпе

С А 3 Е о 5 10 15 20 ЬаЬе! Шв Н- 1------- \------- * 1—-

3 9 2 8

10 1

5 7

| Т |

| иг |

| т |

Рис.19.4. Дендрограмма для 10 студентов (метод полной связи)

му что этот последний к нему ближе, чем самый дальний объект кластера (8, 10, 1). На этом же основании кластер (4, 6) присоединяется к кластеру (5, 7), потому что самый дальний объект 6 кластера (4, 6) ближе к самому дальнему объекту 7 кластера (5, 7), чем к самому дальнему объекту 8 кластера (8, 10, 1).

Метод средней связи (Луега$

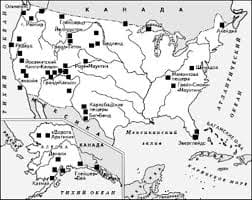

Система охраняемых территорий в США Изучение особо охраняемых природных территорий(ООПТ) США представляет особый интерес по многим причинам...

Что будет с Землей, если ось ее сместится на 6666 км? Что будет с Землей? - задался я вопросом...

ЧТО ТАКОЕ УВЕРЕННОЕ ПОВЕДЕНИЕ В МЕЖЛИЧНОСТНЫХ ОТНОШЕНИЯХ? Исторически существует три основных модели различий, существующих между...

ЧТО ПРОИСХОДИТ ВО ВЗРОСЛОЙ ЖИЗНИ? Если вы все еще «неправильно» связаны с матерью, вы избегаете отделения и независимого взрослого существования...

Не нашли то, что искали? Воспользуйтесь поиском гугл на сайте: